-

Online bezpečnost

Online bezpečnost

-

Umělá inteligence - pomocník i hrozba

- Co je umělá inteligence a jak se učí?

- Umělá inteligence: Přehled klíčových pojmů

- Umělá inteligence: Pochopení benefitů a omezení v online světě

- Umělá inteligence a její rizika

- AI bias a halucinování

- AI - Fake news a dezinformace

- Umělá inteligence a osobní informace

- AI - Klonování lidského hlasu

- Promptování – jak správně komunikovat s AI

- Promptování – tipy a triky, jak dostat co nejlepší odpověď

- Deep nudes: nebezpečný trend umělé inteligence

- Když umělá inteligence tvrdí, že nám rozumí: o falešném pocitu blízkosti s chatboty

- Vzdělávací podklady

-

Digitální zdraví: jak technologie ovlivňují naši psychiku a sebevnímání

- Nejen tělo, i duše může marodit

- Úzkostné poruchy můžou ničit vztahy i školní výsledky. Jak na ně?

- Když ti starosti přerostou přes hlavu, neboj se říct si o pomoc

- Jak najít v záplavě technologií čas na své #dobrenitro?

- Jak odolat digitálním lákadlům a lépe se soustředit na práci?

- Návyky pro lepší produktivitu

- Zkuste digitální minimalismus

- Vliv sociálních sítí na vnímání vlastního těla

- Sociální sítě a poruchy příjmu potravy

- Pomozte svým dětem používat technologie zdravě

- Vzdělávací podklady

-

Digitální závislosti a rizikové chování

-

Kybernetická šikana

-

Sexting

-

Online radikalizace

-

Phishing, viry a sociální inženýrství

-

Bezpečné seznamování online

-

Jak mluvit s dětmi o online bezpečí

-

Kybergrooming

-

Kyberstalking

-

Nakupování online

-

Ukradené a falešné účty

-

Rizikové online výzvy (challenges)

-

Děti a porno: společně na internetu

-

Průvodce rodičovskou kontrolou v online prostoru

-

-

Počítačová gramotnost

Počítačová gramotnost

-

Bezpečné heslo

-

Připojujte se na Wi‑Fi bezpečně

-

Jak se chránit na sociálních sítích

- Na sociálních sítích se podvodům daří. A můžeme za to my

- 10 tipů, jak si chránit sociální sítě

- WhatsApp a děti: rizika, pravidla a prevence

- Nastavení Facebooku od A do Z

- Instagram a jak si na něm nastavíte soukromí

- TikTok se dá zabezpečit. Ukážeme vám to

- I na WhatsAppu si můžete nastavit soukromí

- Snapchat - základní zabezpečení a ochrana soukromí

- Vzdělávací podklady

-

Algoritmy sociálních sítí

-

Jak chránit svá data, počítač a mobil

-

Psaní všemi deseti

-

Online hry

-

Cookies

-

-

Mediální gramotnost

Mediální gramotnost

-

Fake news, deepfake a hoaxy

- Kde se vzaly dezinformace, deepfakes a hoaxy?

- Co jsou dezinformace a proč vůbec vznikají

- Kdo dezinformacím věří, a kdo je naopak šíří?

- Jsou deepfakes nebezpečné, nebo jde o nevinnou zábavu?

- Hoaxy aneb Proč nás baví si na netu vymýšlet

- Clickbait pod lupou: co to je a proč je nebezpečný

- Jak na netu poznat zmanipulované fotky

- Jak ověřovat fotky

- 6 tipů, jak nenaletět dezinformacím a hoaxům

- Konspirační teorie hýbou internetem

- Euromýty. Už jste o nich slyšeli?

- Populární sociální sítě roku 2023

- Verifee: Jak poznat manipulativní zprávy na první pohled

- Vzdělávací podklady

-

Autorská práva

- Co byste měli vědět o autorském díle

- Při stahování se hodí znalost licencí

- Stahování dat – co se může a nemůže

- Jak neporušovat autorská práva na netu

- Proč nelegální stahování škodí filmu

- Víte, jaká pravidla jsou spojena se zveřejněním fotografie na sociálních sítí? Děti i dospělí si to často neuvědomují

- Vzdělávací podklady

-

Typy médií

-

Ochrana osobních údajů

-

Reklama

-

Mediální stereotypy

-

Propaganda a cenzura

-

-

Technologie ve vzdělávání

Technologie ve vzdělávání

-

Výuka moderních dějin s využitím digitálních technologií

-

Online vzdělávání

- Technologie a vzdělávání

- Zásady online vzdělávání

- Jak na vyučování s pomocí videohovoru?

- Nástroje a aplikace: komplexní e‑learningová řešení

- Nástroje a aplikace: komunikace a videokonference

- Nástroje a aplikace: testovací a zkoušecí systémy

- Nástroje a aplikace: plánovací a organizační systémy

- Tipy a triky pro vyučování matematiky online

- Vzdělávací podklady

-

Rozšířená realita (AR)

-

3D tisk – technologie budoucnosti

-

Google Učebna a G Suite pro vzdělávání

- Google Učebna a G Suite pro vzdělávání

- Založení a ověření účtu

- Základní nastavení a práce s uživateli

- Založení třídy a kurzů

- Jak na videohovory?

- Práce se soubory a úložištěm Disk Google

- Dokumenty Google a komentáře mezi studenty a učiteli

- Jak na testy, přihlášky a dotazníky?

- Další aplikace G Suite: Tabulky, prezentace a poznámky

- Učebna Google z pohledu učitele

- Učebna Google z pohledu žáků a studentů

- Tip: Materiály můžete kopírovat a znovu použít

- Tip: Jak na internetovou tabuli Google Jamboard

- Tip: Jak žákům zakázat chat a další novinky

- Tip: Jak snadno komentovat, opravovat a známkovat

- 13 tipů pro zabezpečení Google Workspace nejen pro online výuku

- Google Učebna: Přestaňte psát komentáře. Raději je žákům namluvte

- Vzdělávací podklady

-

Microsoft Teams a Office 365 pro školy

- Microsoft Teams a Office 365

- Založení účtu Office 365 pro školy

- Administrace Office 365 a přidání uživatelů

- Aktivity, kanály a karty

- Audiohovory a videohovory

- Tip: Jak na jednoduché ankety a hlasování?

- Tip: Docházka do online hodiny

- Tip: Jak vypnout vyskakovací okno chatu

- Tip: 6 tipů pro bezpečnou online výuku v MS Teams

- Tip: Obsah prezentace se zobrazuje ve vašem režimu

- Tip: Třídu můžete rozdělit do samostatných místností

- Tip: Jak odevzdávat vyfocené pracovní listy?

- Tip: Jak napsat nebo připnout důležitou zprávu?

- Tip: Jak žákům vypnout v online hodině chat

- Tip: Jak zajistit, aby hodinu začínal a končil učitel?

- Tip: Jak vytvořit online třídní schůzku

- Tip: Další možnosti využití MS Teams pro školy

- Tip: Aplikace pro tvorbu kvízů Kahoot

- V MS Teams je nově užitečný nástroj pro schvalování "čehokoliv"

- Vzdělávací podklady

-

Minecraft: Education Edition

-

Robotické programovatelné pomůcky

- Co umí robotické pomůcky pro výuku?

- Robotické autíčko Sphero indi

- Robotická včelka Bee‑Bot

- Robotická beruška Blue‑bot

- Robotická myš Code & Go

- Robotické autíčko Pro‑bot

- Robotická sova Artie 3000

- Robotické hračky Sphero

- Cozmo a Vector: Roboti s osobností

- Futuristický CUE robot

- Humanoidní roboti - Alpha 1S

- Matatalab Programovatelný robot

- Robotická housenka CODE A Pillar

- Robotický hlemýžď QOBO

- Robot Zigybot Woki

- Robot Codey Rocky

- Intelino

- Vzdělávací podklady

-

Programování s Ozoboty

-

Virtuální realita (VR) ve vzdělávání

-

Další zajímavé "hračičky" a gadgety

-

Digitalizujeme školy

- V digitálním světě už žádné zbytečné papíry potřebovat nebudete

- Uživatelský profil v Národním bodu pro identifikaci a autentizaci (NIA)

- Při komunikaci s úřady už na poštu nemusíte

- Jak založit Identitu občana

- Datová schránka pro komunikaci

- Praktické tipy, jak si datovkou zjednodušit fungování organizace

- Vzdělávací podklady

-

Elektronické stavebnice řady Boffin

-

AI - Klonování lidského hlasu

Jedním z významných rizik spojených s umělou inteligencí a autorskými právy je klonování lidského hlasu. Technologie AI je schopna velmi realisticky napodobit hlas konkrétní osoby, což může být vnímáno jako zásah do osobnostních práv, jelikož hlas je považován za citlivý osobní údaj. Zvláštní etické dilema pak vyvstává při oživování hlasů zesnulých, například herců nebo jiných známých osobností. Často se totiž stává, že rodiny zesnulých nesouhlasí s tím, aby byl jejich příbuzný takto „oživován“ a komerčně využíván (například pro dabing filmů či seriálů). Dalším kontroverzním tématem je možnost „oživení“ mrtvých osob prostřednictvím jejich virtuálních avatarů. I v tomto případě využití AI nástrojů narážíme na řadu etických otázek.

K vytvoření naklonovaného hlasu nám stačí několikasekundový záznam konkrétní osoby, který se nahraje do speciální AI aplikace. Tato technologie se naučí hlas napodobit a následně podle textových zadání generuje hlas tak realisticky, že je k nerozeznání od originálu. Příkladem takového nástroje je ElevenLabs (https://elevenlabs.io), který umožňuje pokročilé klonování hlasu.

Použití umělé inteligence k napodobení lidského hlasu představuje zásadní hrozby, zejména v oblasti bezpečnosti, ochrany soukromí a důvěry veřejnosti. Mezi nejvýznamnější rizika patří možnost zneužití této technologie k podvodným aktivitám. Jako příklad si uveďme incident z roku 2024, kdy se automobilka Ferrari stala terčem deepfake útoku. Podvodník dokázal velmi přesvědčivě napodobit hlas generálního ředitele společnosti, aby přesvědčil finančního ředitele k převodu vysoké sumy peněz. Tento pokus se však nezdařil díky speciálním otázkám, na které mohl správně odpovědět pouze skutečný ředitel.

Dalším příkladem je incident spojený s prezidentskou předvolební kampaní v USA v roce 2024. Tisícům voličů telefonoval falešný prezident Biden. Šlo ale o falešnou nahrávku. Za vším stál demokrat Steve Kramer a pouliční kouzelník Paul Carpenter, kteří za pomoci technologie klonování hlasu vytvořili fiktivní záznam prezidentova hlasu. Tento případ jasně ukazuje, jak snadno lze takovou technologii využít k manipulaci veřejnosti a jak vážně může ohrozit demokratické procesy, například průběh voleb.

Podobná situace nastala i na Slovensku, kde byl pomocí umělé inteligence vytvořen falešný záznam hlasu jednoho z kandidujících politiků. V rámci fiktivního rozhovoru odpovídal na otázky novinářky a hovořil mimo jiné o tom, jak bude falšovat volby. Tento záznam se rychle rozšířil po internetu a zcela jistě volby ovlivnil, byť přesný rozsah jeho dopadu není znám.

Schopnost klonovat lidský hlas tak nepředstavuje riziko pouze v oblasti finančních podvodů, ale může výrazně ovlivnit i společenské a politické procesy, s potenciálně dalekosáhlými důsledky.

Klonování hlasu představuje i zásadní ohrožení soukromí. K vytvoření věrohodného hlasového klonu stačí pár veřejně dostupných nahrávek, což ohrožuje každého, kdo nějakým způsobem veřejně vystupuje. Častým cílem jsou vedle politiků a podnikatelů také celebrity. Ztráta kontroly nad vlastním hlasem pak neznamená jen zásah do identity, ale také omezené možnosti, jak se proti podobným útokům účinně bránit.

Tyto a další příklady zneužívání klonovaných hlasů k podvodům a šíření dezinformací jen zdůrazňují nutnost jak technologické, tak legislativní regulace. Klíčovou roli hraje vývoj nástrojů pro detekci manipulovaných hlasů, avšak tyto technologie mají stále své limity. Současně právní rámec na ochranu proti neautorizovanému klonování hlasu výrazně zaostává za tempem technologického pokroku. Takové situace vytváří nebezpečné prostředí, kde je snadné narušit důvěru a kde rizika nadále narůstají.

Tým E-Bezpečí

Zdroje:

Nordyke, K. (2023). Robin Williams Daughter Zelda Criticizes Using AI to Re-create His Voice. The Hollywood Reporter. https://www.hollywoodreporter.com/business/digital/robin-williams-zelda-criticizes-ai-recreate-his-voice-1235605805/

Mára, O. (2024). Ferrari čelilo deepfake útoku, podvodník téměř dokonale napodobil hlas šéfa značky. Novinky.Cz. https://www.novinky.cz/clanek/auto-ferrari-celilo-deepfake-utoku-podvodnik-temer-dokonale-napodobil-hlas-sefa-znacky-40482168

Dohnal, M. (2024). Telefonáty falešného Bidena objasněny. Stál za nimi demokrat, jemuž pomáhal ohýbač vidliček. Novinky.Cz. https://www.novinky.cz/clanek/zahranicni-amerika-falesny-biden-telefonoval-tisicum-volicu-stal-za-tim-demokrat-a-poulicni-kouzelnik-40462033

Fišer, J. (2023). Slovenské volby ovlivnila umělá inteligence: extrémně nebezpečný je deepfake. CHIP.Cz. https://www.chip.cz/slovenske-volby-ovlivnila-umela-inteligence-extremne-nebezpecny-je-deepfake

Praktické cvičení – Jak proměnit fotografii či obrázek v mluvícího avatara?

Krok po kroku si ukážeme, jak se dá pomocí umělé inteligence proměnit běžná fotografie, obrázek nebo kresba v mluvící postavu, která k nám promlouvá a říká to, co chceme, aby říkala. Obsah konkrétní promluvy zadáme umělé inteligenci pomocí textů. AI následně promění statický obrázek či fotografii v mluvicího avatara. Toto cvičení ocení především ti, kteří chtějí vytvářet materiály například do dějepisu pro motivační část hodiny. Ukážeme si totiž, jak rozmluvit významnou osobnost – konkrétně k nám bude promlouvat biskup Jednoty bratrské a pedagog Jan Amos Komenský.

Název aplikace: D-iD

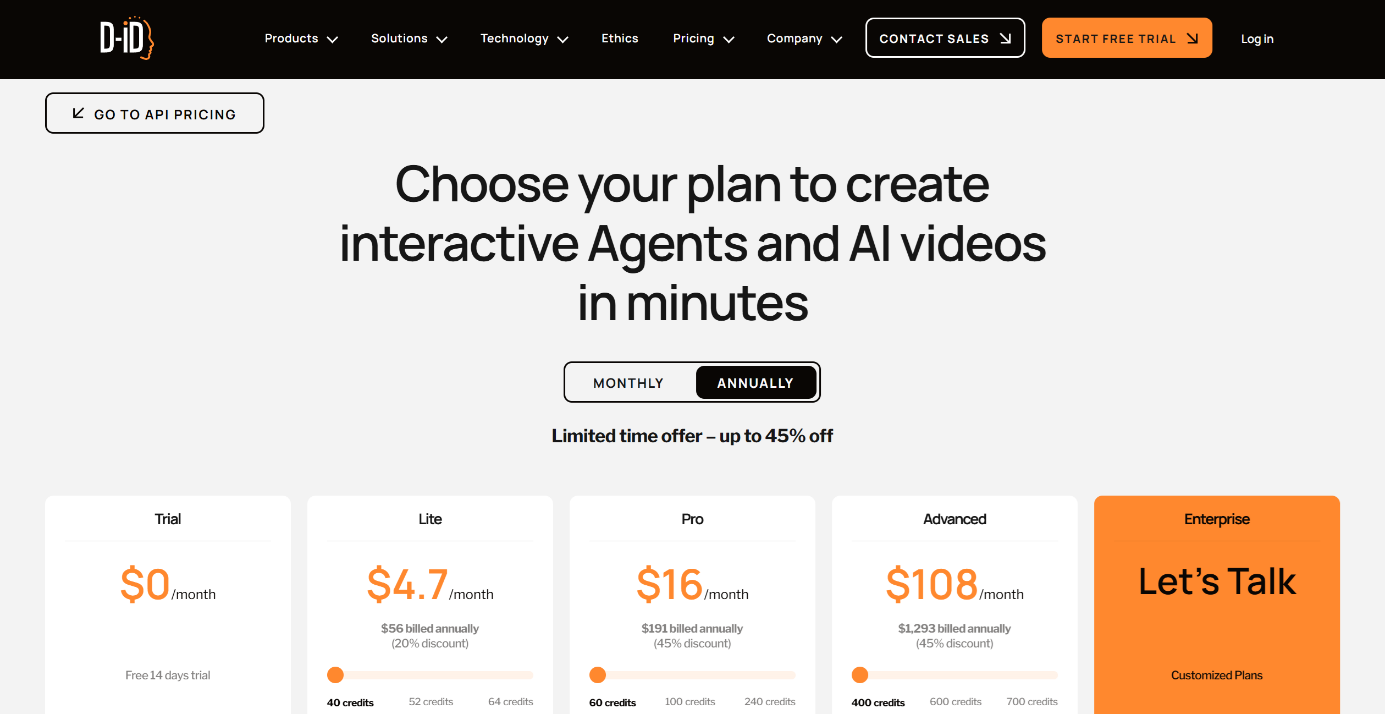

Pro praktickou ukázku využijeme aplikaci D-iD, kterou si můžete vyzkoušet zdarma v základní verzi (Trial). Pokud byste chtěli tuto aplikaci využívat pravidelně, bude potřeba zaplatit měsíční poplatek, který je přibližně 5 dolarů. Cena může růst v závislosti na tom, kolik avatarů budete vytvářet, jak dlouhá videa budete generovat apod. Pro toto cvičení nám bude stačit zkušební verze, kterou spustíme kliknutím na oranžové tlačítko START FREE TRIAL umístěné v horní části obrazovky, případně se rovnou zaregistrujeme.

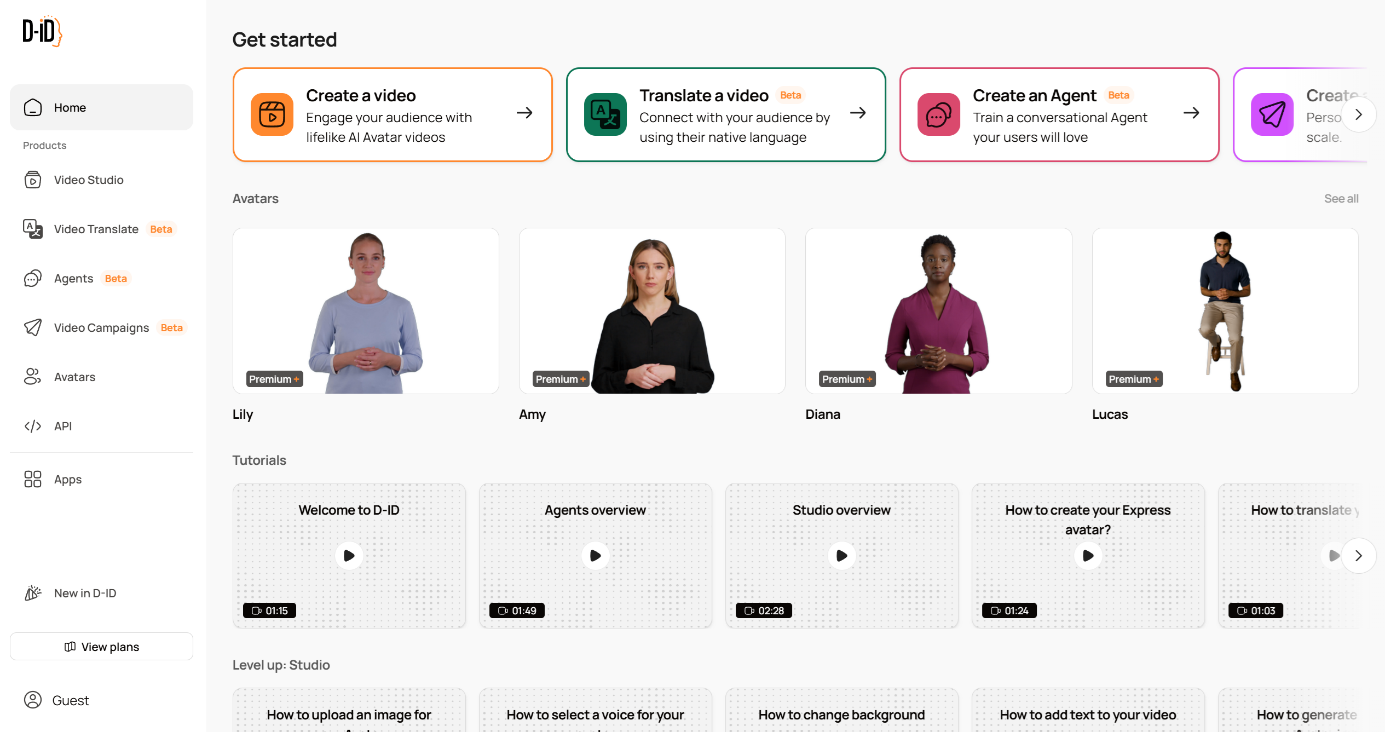

Jakmile se přihlásíme a spustíme aplikaci D-iD, opět v horní části obrazovky najdeme a vybereme možnost Create a video.

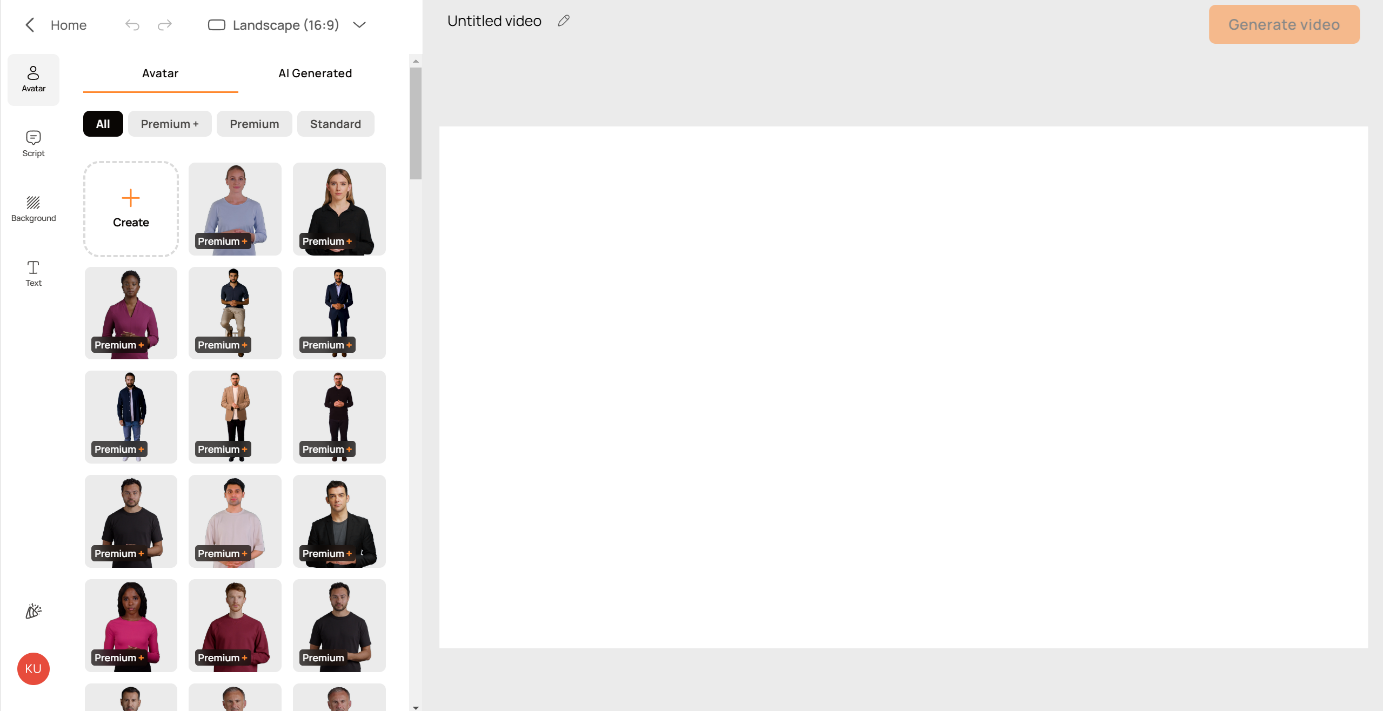

Na levé straně obrazovky se objeví nabídka, pomocí které si můžeme do aplikace nahrát vlastní obrázek či fotografii, případně můžeme využít již hotové avatary nebo si vygenerovat zcela nové. My si ale ukážeme, jak rozmluvit náš vlastní obrázek, který do aplikace teprve vložíme s pomocí tlačítka Create v levé části obrazovky.

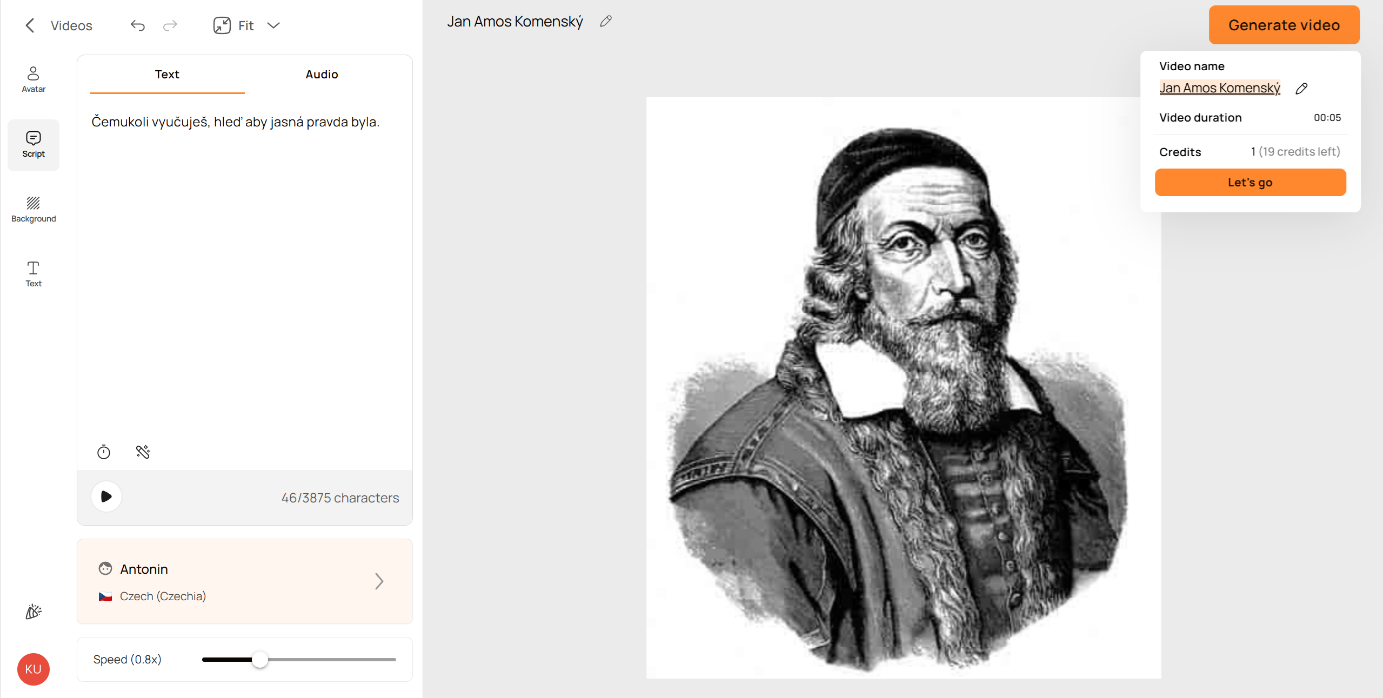

Upozorňujeme, že stále více podobných aplikací, které nabízí možnost generovat mluvící avatary s pomocí umělé inteligence, začíná zakazovat používání fotografií známých osobností (celebrity, politici apod.). Nemusí vám tedy automaticky fungovat všechny fotografie, které chcete použít. Jak jsme ale zmínili v úvodu, na konci tohoto cvičení k nám bude promlouvat Jan Amos Komenský a s jeho kresbou žádný problém není. Nejprve tak do aplikace nahrajeme obrázek známého pedagoga a následně si z nabídky v horní části obrazovky vybereme formát videa (v našem případě formát Fit, ale můžete využít např. 16:9 nebo 1:1).

V dolní části obrazovky si z nabídky vybereme jazyk, kterým k nám bude Komenský promlouvat. Ve zkušební verzi je výběr hlasu značně omezen, ale i tak zde najdeme českou variantu (hlas Antonin), která nám pro ukázku postačí. Pokud máte zaplacenou vyšší verzi, najdete zde daleko více variant (ženské i mužské hlasy).

Jakmile máme vybraný hlas, přepneme se v menu na levé straně obrazovky do sekce Script, kde už najdeme textové pole, kam zadáme to, co má vybraná osoba říkat. Nástroj D-iD zde nabízí i možnost využít vlastní audio soubory (Upload audio). My využijeme možnost zadat promluvu v textové podobě, a použijeme citát, jehož autorem je právě Jan Amos Komenský. I zde v sekci Script můžeme nadále měnit hlas podle libosti, a dokonce tento hlasový projev zrychlit, nebo zpomalit.

V další sekci Background můžeme přidávat různobarevná pozadí. Pod poslední nabídkou Text najdeme samozřejmě možnost vkládat dodatečné texty přímo do videa. Na výběr máme z mnoha fontů a barevných stylů.

Vše již máme připravené a stačí vygenerovat video. Klikneme na oranžové tlačítko Generate video umístěné v horní části obrazovky a vyskočí na nás kontextové okno, kde můžeme ještě upravit název videa. Zároveň se zde dozvíme, jak dlouhé bude výsledné video a že nás bude stát jeden kredit. Nakonec klikneme na oranžové tlačítko Let’s go a umělá inteligence během pár vteřin vygeneruje výsledné video. Pokud je video delší, může to trvat i několik minut. V našem případě jsme prakticky okamžitě dostali povedený výsledek. Jan Amos Komenský lehce pohybuje hlavou, mrká a samozřejmě otevírá ústa. Synchronizace pohybů rtů (lip sync) je též poměrně zdařilá.

Výsledné video můžeme sdílet (Share), vytvořit kopii, kterou lze dále upravovat (Edit as new) nebo stáhnout do počítače (Download) a dále s ním pracovat. Pokud se vám nelíbí hlas, který jste použili, vyberte si v nabídce jiný nebo využijte nějakou specifičtější aplikaci na syntézu řeči, například nástroj ElevenLabs (https://elevenlabs.io).

Tým E-Bezpečí

Zdroje:

Storeide, A. J. (n.d.). Johann Amos Comenius. Store norske leksikon. Retrieved November 25, 2024, from https://snl.no/Johann_Amos_Comenius

Jan Amos Komenský. (n.d.). Wikiquote. Retrieved November 25, 2024, from https://cs.wikiquote.org/wiki/Jan_Amos_Komensk%C3%BD